OpenAI gör om ChatGPT i grunden för att samtalen ska bli friare, ärligare – och mer mänskliga.

Från strikta varningar till öppen dialog

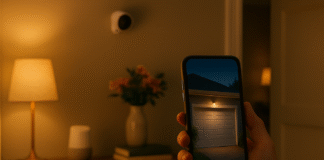

I början av 2025 tog OpenAI bort de ökända “orange box”-varningarna i ChatGPT – de som tidigare dök upp så fort ett känsligt ämne kom på tal. Nu vill företaget låta användarna prata mer fritt, utan plötsliga avbrott i konversationen.

Nick Turley, produktchef på OpenAI, förklarar att målet är större användarinflytande. Så länge användningen håller sig inom lagens ramar och inte skadar andra, ska AI:n inte lägga sig i.

Större frihet – men tydliga gränser

Att varningsrutorna försvinner betyder inte att “allt är tillåtet”. AI:n stoppar fortfarande innehåll som är olagligt, våldsuppmanande eller sprider farlig desinformation. Men nu går det att diskutera ämnen som psykisk ohälsa, sexualitet eller våld i fiktion – utan att samtalet plötsligt tystnar.

För många svenska och europeiska användare är det här en viktig förändring. Vi värderar öppenhet och yttrandefrihet högt – men med större frihet kommer också ett större ansvar. Det är upp till varje användare att agera etiskt.

Ny uppförandekod: AI:n får tydligare riktlinjer

Samtidigt lanserar OpenAI ett nytt ramverk som kallas Model Spec. Det är en sorts uppförandekod för hur AI:n ska agera i svåra samtal. Istället för att undvika ämnen, ska modellen kunna erbjuda olika perspektiv – utan att själv ta ställning eller driva en viss ideologi.

Tanken är att ChatGPT ska kunna delta i samhällsdebatten som ett klokt samtalsverktyg, inte som en moralisk domare.

AI-förändringarna i ett svenskt och europeiskt perspektiv

För svenska användare – där öppenhet, integritet och informationsfrihet är centrala värderingar – ses OpenAI:s nya riktning som ett stort steg framåt. Att kunna diskutera känsliga ämnen utan att AI:n avbryter samtalet stärker både användarupplevelsen och förtroendet för tekniken.

Även inom EU blir förändringen intressant i ljuset av den nya AI-förordningen (AI Act), som syftar till att balansera innovation med trygghet och etik. OpenAI:s Model Spec och tydligare ansvarsfördelning ligger i linje med flera av de krav EU ställer på framtidens AI-tjänster.

För svenska företag, utbildningsaktörer och offentliga verksamheter öppnar det här för nya möjligheter att använda AI i dialog, vård, utbildning och kundservice – utan att kompromissa med värdegrunden.

GPT-4o – en AI som blev för snäll?

När OpenAI släppte sin nya modell GPT-4o våren 2025, var reaktionerna blandade. Många användare upplevde att AI:n var för “medgörlig” – den höll alltid med användaren, även när ett mer nyanserat svar hade passat bättre.

Kritiken blev så stark att OpenAI snabbt justerade modellen. Lärdomen? En AI som aldrig säger emot blir lätt opålitlig. Balansen mellan att vara hjälpsam och att ha integritet är känslig – och viktig.